22 Maggio 2024

Gli scienziati del Salk sviluppano una nuova tecnica per misurare la forza e la plasticità delle sinapsi, supportando nuove ricerche sull'apprendimento e la memoria e su come questi processi diminuiscono con l'invecchiamento e le malattie

Gli scienziati del Salk sviluppano una nuova tecnica per misurare la forza e la plasticità delle sinapsi, supportando nuove ricerche sull'apprendimento e la memoria e su come questi processi diminuiscono con l'invecchiamento e le malattie

LA JOLLA—A ogni giro di carte con parole del vocabolario, le definizioni diventano più rapide e facili. Questo processo di apprendimento e memorizzazione di nuove informazioni rafforza importanti connessioni nel cervello. Ricordare più facilmente nuove parole e definizioni con la pratica è la prova che queste connessioni neurali, chiamate sinapsi, possono rafforzarsi o indebolirsi nel tempo, una caratteristica nota come plasticità sinaptica.

Quantificare le dinamiche delle singole sinapsi può rappresentare una sfida per i neuroscienziati, ma le recenti innovazioni computazionali del Salk Institute potrebbero cambiare le cose, rivelando nel frattempo nuove intuizioni sul cervello.

Per capire come il cervello impara e conserva le informazioni, gli scienziati cercano di quantificare quanto una sinapsi è diventata più forte attraverso l'apprendimento e quanto più forte è diventata può ottenere. La forza sinaptica può essere misurata osservando le caratteristiche fisiche delle sinapsi, ma è molto più difficile misurare la precisione della plasticità (se le sinapsi diventano più deboli o più forti in modo costante) e della quantità di informazioni che una sinapsi può immagazzinare.

Gli scienziati del Salk hanno sviluppato un nuovo metodo per esplorare la forza sinaptica, la precisione della plasticità e la quantità di informazioni immagazzinate. Quantificare queste tre caratteristiche sinaptiche può migliorare la comprensione scientifica di come gli esseri umani apprendono e ricordano, nonché di come questi processi si evolvano nel tempo o si deteriorino con l'età o le malattie. I risultati sono stati pubblicati su Calcolo neurale aprile 23, 2024.

"Stiamo migliorando nell'identificare esattamente dove e come i singoli neuroni sono collegati tra loro, ma abbiamo ancora molto da imparare sulle dinamiche di queste connessioni", afferma il professor Terrence Sejnowski, autore senior dello studio e titolare della cattedra Francis Crick al Salk. "Abbiamo ora creato una tecnica per studiare la forza delle sinapsi, la precisione con cui i neuroni modulano tale forza e la quantità di informazioni che le sinapsi sono in grado di immagazzinare, portandoci a scoprire che il nostro cervello può immagazzinare volte 10 più informazioni di quanto pensassimo in precedenza."

Quando un messaggio viaggia attraverso il cervello, salta da un neurone all'altro, fluendo dall'estremità di un neurone ai tentacoli distesi, chiamati dendriti, di un altro. Ogni dendrite di un neurone è ricoperto da minuscole appendici bulbose, chiamate spine dendritiche, e all'estremità di ogni spina dendritica si trova la sinapsi, un minuscolo spazio in cui le due cellule si incontrano e viene trasmesso un segnale elettrochimico. Sinapsi diverse vengono attivate per inviare messaggi diversi.

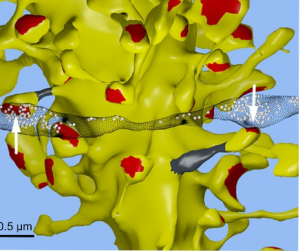

Alcuni messaggi attivano coppie di sinapsi, che vivono vicine l'una all'altra sullo stesso dendrite. Queste coppie di sinapsi sono uno strumento di ricerca fantastico: se due sinapsi hanno storie di attivazione identiche, gli scienziati possono confrontare la loro intensità per trarre conclusioni sulla precisione della plasticità. Poiché lo stesso tipo e quantità di informazioni è passato attraverso queste due sinapsi, la loro intensità è cambiata della stessa quantità? In tal caso, la loro precisione di plasticità è elevata.

Il team del Salk ha applicato concetti della teoria dell'informazione per analizzare coppie di sinapsi provenienti dall'ippocampo di un ratto – una parte del cervello coinvolta nell'apprendimento e nella memoria – per valutarne la resistenza, la plasticità e la precisione. La teoria dell'informazione è un sofisticato approccio matematico per comprendere l'elaborazione delle informazioni come un input che viaggia attraverso un canale rumoroso e viene ricostruito all'altra estremità.

Fondamentalmente, a differenza dei metodi utilizzati in passato, la teoria dell'informazione tiene conto della rumorosità dei numerosi segnali e delle cellule del cervello, oltre a offrire un'unità discreta di informazione, un bit, per misurare la quantità di informazioni immagazzinate in una sinapsi.

"Abbiamo suddiviso le sinapsi in base alla loro forza, che comprendeva 24 possibili categorie, e poi abbiamo confrontato coppie di sinapsi specifiche per determinare con quanta precisione venga modulata la forza di ciascuna sinapsi", afferma Mohammad Samavat, primo autore dello studio e ricercatore post-dottorato nel laboratorio di Sejnowski. "Siamo stati entusiasti di scoprire che le coppie avevano dimensioni delle spine dendritiche e forza sinaptica molto simili, il che significa che il cervello è estremamente preciso quando rende le sinapsi più deboli o più forti nel tempo".

Oltre a notare le somiglianze nella forza sinaptica all'interno di queste coppie, che si traducono in un elevato livello di precisione della plasticità, il team ha anche misurato la quantità di informazioni contenute in ciascuna delle 24 categorie di forza. Nonostante le differenze nelle dimensioni di ciascuna spina dendritica, ciascuna delle 24 categorie di forza sinaptica conteneva una quantità simile (tra 4.1 e 4.6 bit) di informazioni.

Rispetto alle tecniche più vecchie, questo nuovo approccio che utilizza la teoria dell'informazione è 1) più completo, in quanto tiene conto di una quantità di informazioni immagazzinate nel cervello 10 volte superiore a quanto si pensasse in precedenza, e 2) scalabile, il che significa che può essere applicato a set di dati diversi e di grandi dimensioni per raccogliere informazioni su altre sinapsi.

"Questa tecnica sarà di grande aiuto per i neuroscienziati", afferma Kristen Harris, professoressa presso l'Università del Texas ad Austin e autrice dello studio. "Avere uno sguardo approfondito alla forza e alla plasticità sinaptica potrebbe davvero dare impulso alla ricerca sull'apprendimento e sulla memoria, e possiamo utilizzarlo per esplorare questi processi in tutte le diverse parti del cervello umano, animale, giovane e anziano".

Sejnowski afferma che il lavoro futuro di progetti come la BRAIN Initiative del National Institutes of Health, che ha stabilito un atlante delle cellule cerebrali umane nell'ottobre 2023, trarranno beneficio da questo nuovo strumento. Oltre agli scienziati che catalogano i tipi e i comportamenti delle cellule cerebrali, la tecnica è entusiasmante per coloro che studiano quando l'archiviazione delle informazioni va male, come in La malattia di Alzheimer.

Negli anni a venire, i ricercatori di tutto il mondo potrebbero utilizzare questa tecnica per fare scoperte entusiasmanti sulla capacità del cervello umano di apprendere nuove competenze, ricordare le azioni quotidiane e immagazzinare informazioni a breve e lungo termine.

L'articolo è stato scritto anche da Thomas Bartol di Salk.

Il lavoro è stato supportato dalla National Science Foundation (DBI-1707356, DBI-2014862, 2219894, IIS-2219979) e dai National Institutes of Health (P41GM103712, MH095980-07, MH115556, MH129066).

DOI: 10.1162/neco_a_01659

JOURNAL

Calcolo neurale

TITOLO

Capacità di immagazzinamento delle informazioni sinaptiche misurata con la teoria dell'informazione

AUTORI

Mohammad Samavat, Thomas M. Bartol, Kristen M. Harris, Terrence J. Sejnowski

Ufficio delle comunicazioni

Tel: (858) 453-4100

press@salk.edu

Il Salk Institute è un istituto di ricerca indipendente e senza scopo di lucro, fondato nel 1960 da Jonas Salk, sviluppatore del primo vaccino antipolio sicuro ed efficace. La missione dell'istituto è quella di promuovere una ricerca fondamentale, collaborativa e rischiosa che affronti le sfide più urgenti della società, tra cui il cancro, il morbo di Alzheimer e la vulnerabilità agricola. Questa scienza fondamentale è alla base di tutti gli sforzi traslazionali, generando intuizioni che consentono nuovi farmaci e innovazioni in tutto il mondo.