20 de enero de 2016

Datos del Instituto Salk muestran que la capacidad de memoria del cerebro está en el rango de los petabytes, tanto como toda la Web.

Datos del Instituto Salk muestran que la capacidad de memoria del cerebro está en el rango de los petabytes, tanto como toda la Web.

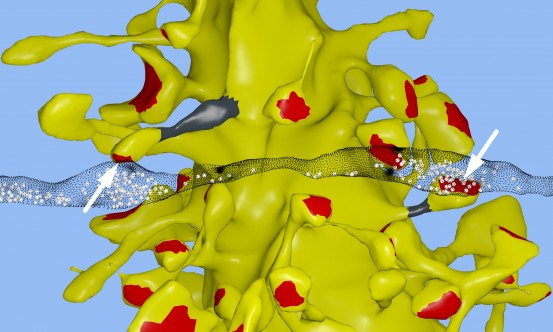

LA JOLLA — Investigadores del Salk y colaboradores han obtenido información crítica sobre el tamaño de las conexiones neuronales, lo que sitúa la capacidad de memoria del cerebro mucho más allá de las estimaciones comunes. El nuevo trabajo también responde a una pregunta de mucho tiempo sobre cómo el cerebro es tan eficiente energéticamente y podría ayudar a los ingenieros a construir computadoras increíblemente potentes pero que también conservan energía.

“Esto es una verdadera bomba en el campo de la neurociencia”, dice Terry Sejnowski, profesor de Salk y coautor principal del artículo, que fue publicado en eLife. “Descubrimos la clave para desvelar el principio de diseño de cómo las neuronas del hipocampo funcionan con baja energía pero con alta potencia de cálculo. Nuestras nuevas mediciones de la capacidad de memoria del cerebro aumentan las estimaciones conservadoras en un factor de 10, a al menos un petabyte, en el mismo orden de magnitud que la World Wide Web.”

Nuestros recuerdos y pensamientos son el resultado de patrones de actividad eléctrica y química en el cerebro. Una parte clave de la actividad ocurre cuando las ramas de las neuronas, muy parecidas a cables eléctricos, interactúan en ciertas uniones, conocidas como sinapsis. Un ‘cable’ de salida (un axón) de una neurona se conecta al ‘cable’ de entrada (una dendrita) de una segunda neurona. Las señales viajan a través de la sinapsis como productos químicos llamados neurotransmisores para indicarle a la neurona receptora si debe transmitir una señal eléctrica a otras neuronas. Cada neurona puede tener miles de estas sinapsis con miles de otras neuronas.

“Cuando reconstruimos por primera vez cada dendrita, axón, proceso glial y sinapsis de un volumen de hipocampo del tamaño de un glóbulo rojo, nos sentimos algo desconcertados por la complejidad y la diversidad entre las sinapsis”, dice Kristen Harris, coautora principal del trabajo y profesora de neurociencia en el Universidad de Texas, Austin. Si bien esperaba aprender principios fundamentales sobre cómo está organizado el cerebro a partir de estas reconstrucciones detalladas, me ha asombrado realmente la precisión obtenida en los análisis de este informe.“

Las sinapsis todavía son un misterio, aunque su disfunción puede causar una variedad de enfermedades neurológicas. Las sinapsis más grandes —con más superficie y vesículas de neurotransmisores— son más fuertes, lo que las hace más propensas a activar sus neuronas circundantes que las sinapsis medianas o pequeñas.

El equipo de Salk, mientras construía una reconstrucción 3D de tejido del hipocampo de rata (el centro de la memoria del cerebro), notó algo inusual. En algunos casos, un solo axón de una neurona formaba dos sinapsis que se extendían hasta una sola dendrita de una segunda neurona, lo que significaba que la primera neurona parecía estar enviando un mensaje duplicado a la neurona receptora.

Al principio, los investigadores no le dieron mucha importancia a esta duplicidad, que ocurre aproximadamente el 10 por ciento de las veces en el hipocampo. Pero Tom Bartol, un científico del Salk, tuvo una idea: si pudieran medir la diferencia entre dos sinapsis muy similares como estas, podrían obtener información sobre los tamaños sinápticos, que hasta ahora solo se habían clasificado en el campo como pequeños, medianos y grandes.

Haga clic aquí para obtener una imagen en alta resolución.

Crédito: Instituto Salk

Para hacer esto, los investigadores utilizaron microscopía avanzada y algoritmos computacionales que habían desarrollado para obtener imágenes de cerebros de ratas y reconstruir la conectividad, las formas, los volúmenes y el área de superficie del tejido cerebral hasta un nivel nanomolecular.

Los científicos esperaban que las sinapsis fueran aproximadamente similares en tamaño, pero se sorprendieron al descubrir que eran casi idénticas.

“Nos sorprendió descubrir que la diferencia en el tamaño de los pares de sinapsis era muy pequeña, en promedio, solo alrededor del ocho por ciento de diferencia en tamaño. Nadie pensó que sería una diferencia tan pequeña. Esto fue una jugarreta de la naturaleza”, dice Bartol.

Debido a que la capacidad de memoria de las neuronas depende del tamaño de las sinapsis, esta diferencia del ocho por ciento resultó ser un número clave que el equipo pudo luego introducir en sus modelos algorítmicos del cerebro para medir cuánta información podría almacenarse potencialmente en las conexiones sinápticas.

Se sabía anteriormente que la variedad de tamaños entre las sinapsis más pequeñas y más grandes era un factor de 60 y que la mayoría eran pequeñas.

Pero munidos del conocimiento de que las sinapsis de todos los tamaños podían variar en incrementos de tan solo el ocho por ciento entre tamaños dentro de un factor de 60, el equipo determinó que podría haber alrededor de 26 categorías de tamaños de sinapsis, en lugar de solo unas pocas.

“Nuestros datos sugieren que hay 10 veces más tamaños discretos de sinapsis de los que se pensaba”, dice Bartol. En términos informáticos, 26 tamaños de sinapsis corresponden a unos 4.7 “bits” de información. Anteriormente, se pensaba que el cerebro era capaz de solo uno o dos bits para el almacenamiento de memoria a corto y largo plazo en el hipocampo.

“Esto es aproximadamente un orden de magnitud más de precisión de lo que nadie jamás hubiera imaginado”, dice Sejnowski.

Lo que hace desconcertante esta precisión es que las sinapsis del hipocampo son notoriamente poco fiables. Cuando una señal viaja de una neurona a otra, típicamente activa esa segunda neurona solo entre el 10 y el 20 por ciento de las veces.

“A menudo nos preguntábamos cómo la notable precisión del cerebro podía surgir de sinapsis tan poco confiables”, dice Bartol. Una respuesta, al parecer, está en el ajuste constante de las sinapsis, promediando sus tasas de éxito y fracaso a lo largo del tiempo. El equipo utilizó sus nuevos datos y un modelo estadístico para determinar cuántas señales se necesitarían para que un par de sinapsis alcanzara esa diferencia del ocho por ciento.

Los investigadores calcularon que para las sinapsis más pequeñas, aproximadamente 1.500 eventos provocan un cambio en su tamaño/capacidad (20 minutos) y para las sinapsis más grandes, solo un par de cientos de eventos de señalización (1 a 2 minutos) provocan un cambio.

“Esto significa que cada 2 o 20 minutos, tus sinapsis aumentan o disminuyen su tamaño. Las sinapsis se están ajustando a sí mismas según las señales que reciben”, dice Bartol.

Haga clic aquí para obtener una imagen en alta resolución.

Crédito: Instituto Salk

“Nuestro trabajo anterior había insinuado la posibilidad de que las espinas y los axones que se sinaptan juntos tendrían un tamaño similar, pero la realidad de la precisión es realmente notable y sienta las bases para formas completamente nuevas de pensar sobre cerebros y computadoras”, dice Harris. “El trabajo resultante de esta colaboración ha abierto un nuevo capítulo en la búsqueda de mecanismos de aprendizaje y memoria”. Harris agrega que los hallazgos sugieren más preguntas para explorar, por ejemplo, si se aplican reglas similares para las sinapsis en otras regiones del cerebro y cómo difieren esas reglas durante el desarrollo y a medida que las sinapsis cambian durante las etapas iniciales del aprendizaje.

“Las implicaciones de lo que encontramos son de gran alcance”, añade Sejnowski. “Escondida bajo el aparente caos y desorden del cerebro hay una precisión subyacente en el tamaño y las formas de las sinapsis que estaba oculta para nosotros”.”

Los hallazgos también ofrecen una valiosa explicación para la sorprendente eficiencia del cerebro. El cerebro adulto despierto genera solo unos 20 vatios de potencia continua, la misma cantidad que una bombilla muy tenue. El descubrimiento de Salk podría ayudar a los científicos informáticos a construir computadoras ultrprecisas pero eficientes en el consumo de energía, en particular aquellas que emplean “aprendizaje profundo” y redes neuronales artificiales, técnicas capaces de aprendizaje y análisis sofisticados, como el reconocimiento y la traducción del habla y de objetos.

“Este truco del cerebro apunta sin lugar a dudas a una forma de diseñar mejores computadoras”, afirma Sejnowski. “La transmisión probabilística resulta ser tan precisa y requiere mucha menos energía tanto para las computadoras como para los cerebros”.”

Otros autores del artículo fueron Cailey Bromer, del Instituto Salk; Justin Kinney, del Instituto McGovern para la Investigación del Cerebro; y Michael A. Chirillo y Jennifer N. Bourne de la Universidad de Texas, Austin.

El trabajo contó con el apoyo de la NIH y el Instituto Médico Howard Hughes.

DIARIO

eLife

AUTORES

Thomas M Bartol, Cailey Bromer, Justin Kinney, Michael A. Chirillo, Jennifer N. Bourne, Kristen M. Harris, Terrence J Sejnowski

Oficina de Comunicaciones

Tel.: (858) 453-4100

press@salk.edu

El Instituto Salk es un centro de investigación independiente y sin fines de lucro fundado en 1960 por Jonas Salk, creador de la primera vacuna segura y eficaz contra la poliomielitis. La misión del Instituto es impulsar una investigación fundamental, colaborativa y audaz que aborde los retos más acuciantes de la sociedad, entre ellos el cáncer, la enfermedad de Alzheimer y la vulnerabilidad agrícola. Esta ciencia fundamental sustenta todos los esfuerzos traslacionales, generando conocimientos que permiten el desarrollo de nuevos medicamentos e innovaciones en todo el mundo.